Gemma4のコンテキスト長とメモリ消費|24GB/32GB Macでの注意点

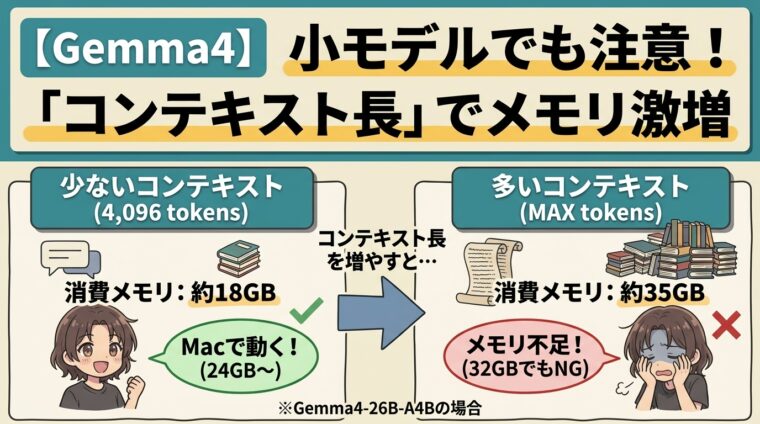

Gemma4-26B-A4Bは、4bit量子化なら約18GBと小さく、24GBや32GBのメモリのMacでも使えそうですが、コンテキスト長(コンテキストサイズ)に注意が必要です。この記事では、コンテキストサイズによる必要メモリ量の変化について解説します。

はじめに

Gemma4とは

Gemma4は、2026年4月に登場したGoogle DeepMind によって構築されたオープンモデルのファミリーです。Gemma4には、E2B, E4B, 26B-A4B, 31Bがあり、26B-A4Bは、性能が高い割には、モデルサイズが約18GB(4bit量子化時)と小さく、24GBや32GBのMacでも動作します。

コンテキスト長(コンテキストサイズ)による変化

ここで注意しなければならないのがコンテキスト長です。モデルサイズが18GBと小さいので、「MacBookでも動作する!」などとSNSで言われていますが、これは、コンテキスト長を無視したサイズです。

実際には、コンテキスト長を長くすればするほどメモリを消費するので、どの程度のコンテキスト長まで使えるかを考えなければなりません。

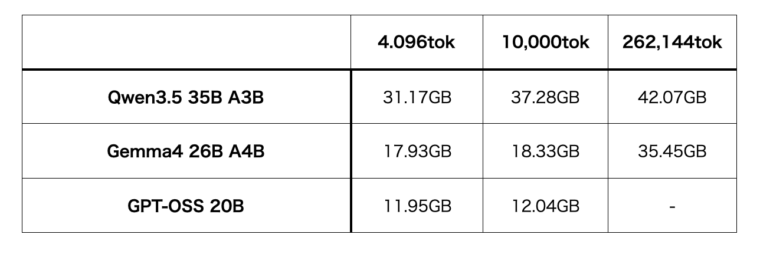

この記事では、Gemma4, Qwen3.5, gpt-ossの3つのモデルのコンテキスト長による必要メモリ量の変化を調べました。

コンテキスト長による変化

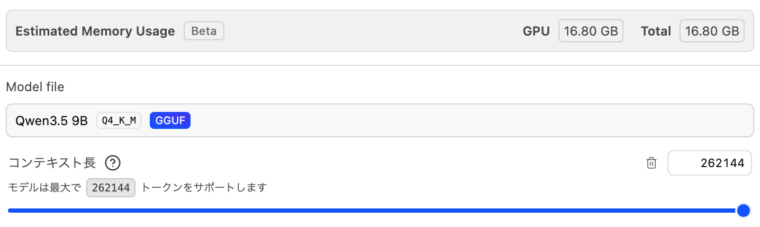

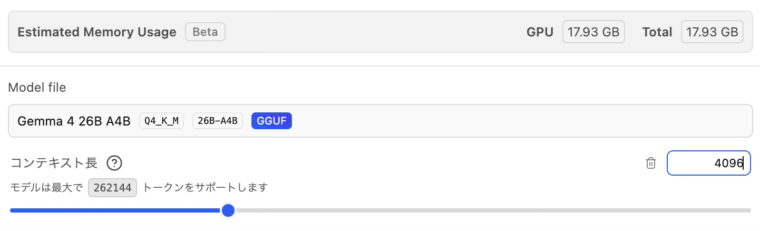

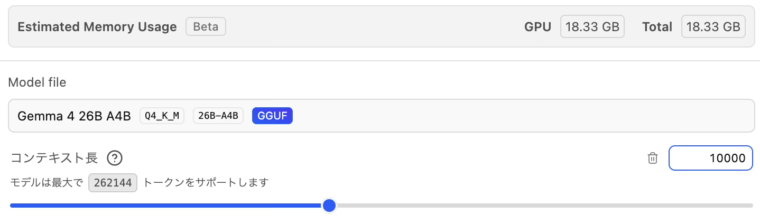

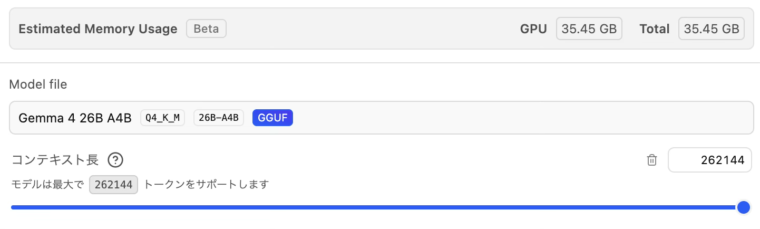

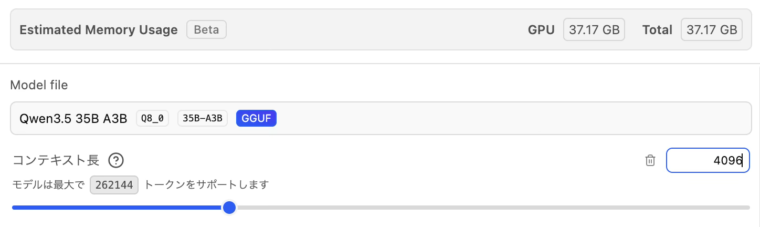

コンテキスト長によるメモリ使用量の変化は、LM Studioの”Estimated Memory Usage”の機能で確認してみました。正確なメモリ使用量ではないですが、目安にはなります。

なお、コンテキスト長4,096, 10,000, MAX(262,144)でチェックしました。

コンテキスト長について

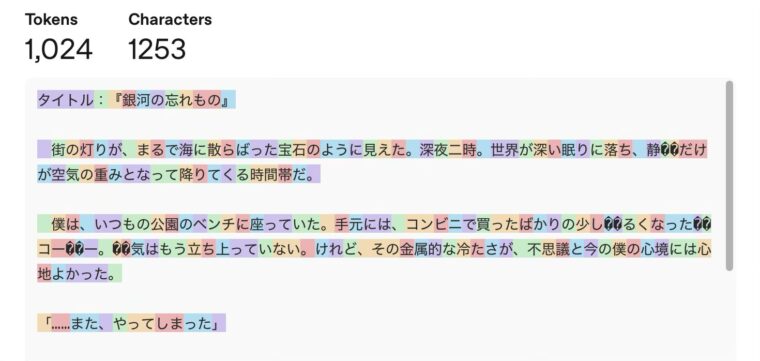

OpenAIのトークナイザーの出力を使って、 文字数とコンテキスト長の関係を調べてみました。モデルによりトークナイザーによる変換に違いがあるのであくまで目安でしかありませんが、参考になるかと思います。

結果を見ると1,253文字で1,024トークンでした。コンテキスト長を文字数換算する場合は、1.1倍~1.2倍の文字数になると考えればよさそうです。

感覚的には、4096トークンだと簡単な会話で消費し、プログラミングだと最低でも10,000トークンは欲しい感じです。10万トークンくらいまで使えれば、普段のやり取りでは問題ない感じです。

ちなみに、25MBのPDFのファイルを読み込ませて要約を頼んだ場合の消費トークン数は17,000くらいでした。

Gemma4-26B-A4B

4096トークン

約18GBを消費します。ほぼモデルサイズです。

10,000トークン

4096トークンと比較すると、+1GBほど消費が増えます

MAXトークン

Maxトークンになると35GBになり、32GBメモリでは収まらなくなります。

ちなみに、実際に使うと、必要メモリ量が一気に増加するタイミングがあります。Estimated Memory Usageはあくまでも目安で、モデルにより精度が違うみたいです。

パソコン側のメモリは「最大使用時」のメモリ容量を意識する必要があるので注意です。

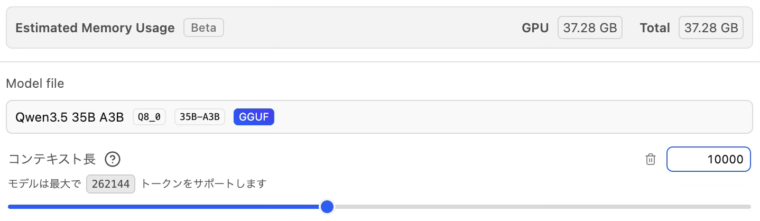

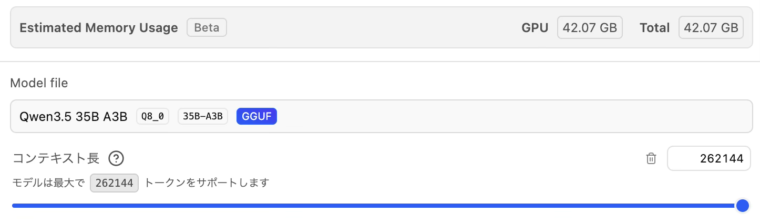

Qwen3.5-35B-A3B

4096トークン

10,000トークン

MAXトークン

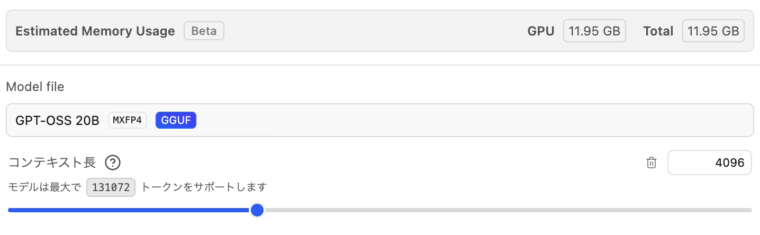

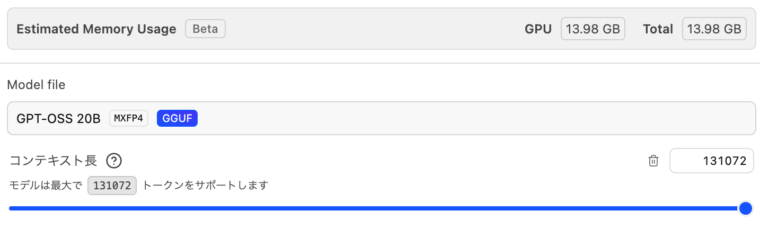

gpt-oss-20b

4096トークン

10,000トークン

MAXトークン(他のモデルより小さいです)

約13万トークンですが、メモリ消費は少なめです。

消費メモリ比較

メモリ消費を表にまとめてみました。Gemma4はモデルサイズは小さいですが、コンテキスト長の増加に対してメモリ消費が一気に大きくなることがわかります。

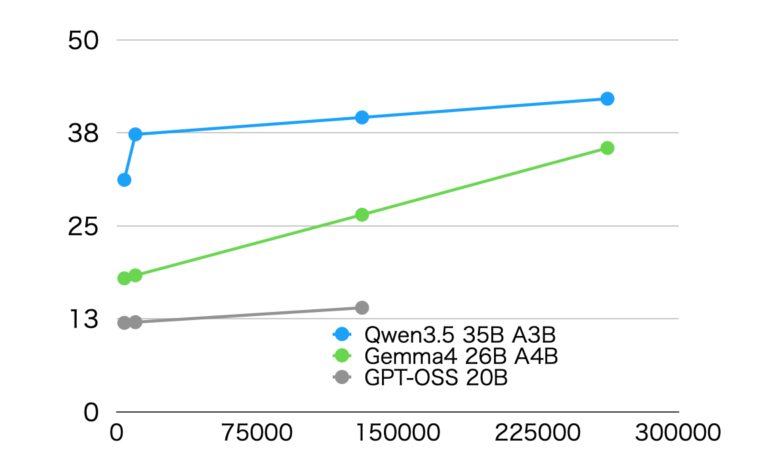

なお、メモリ増加のグラフです。Qwen3.5の売りであるDeltaNetの効果か、トークン数増加によるメモリ消費の増加が少なめです。

Gemma4は、ほぼ線形にメモリ消費量が増えます。

これを見ると、Gemma4-26B-A4Bはモデルサイズが小さいので24GBといったメモリしか搭載していないMacで動きますが、コンテキスト長はあまり大きくできないことがわかります。

個人的には、メモリを残しておきたいので、コンテキスト長は10,000~20,000程度が実用的な限界だと思います。

コンテキスト長を伸ばしたいならgpt-oss-20bが、この3つの中ではベストだと思います。

まとめ

モデルサイズが小さくても、コンテキスト長を大きくするとメモリ消費が増えることを解説しました。要約タスクなどではコンテキスト長が長くなりやすいので、用途によっては24GBのMacBookではGemma4-26B-A4Bは使いにくいかもしれません。とはいえ、これより小さいモデルは性能面が気になります。

個人的には、メモリ使用量と性能のバランスの良いGemma3.5-9Bがやはりおすすめです。

このモデルはコンテキスト長を26万まで増やしてもメモリ使用量は17GBとリーズナブルな範囲に収まります。10万くらいで使えば、メモリ使用量も10GBと搭載メモリの半分程度に抑えることができ、スワップによるストレスなどが減ります。