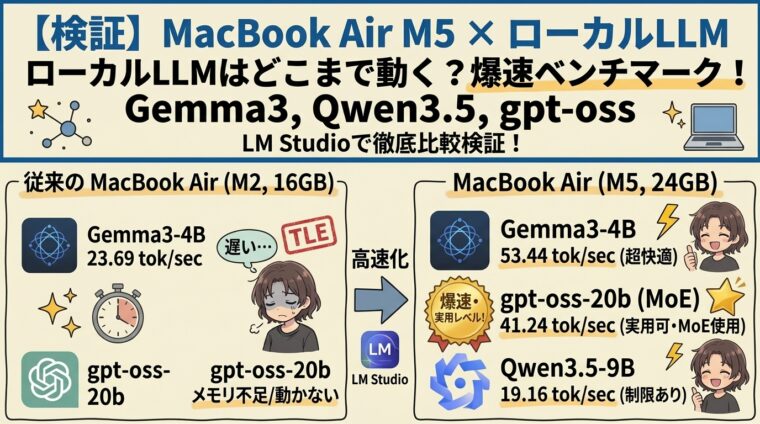

MacBook Air M5でローカルLLMはどこまで動く?LM StudioでGemma3・Qwen3.5・gpt-ossを速度ベンチマーク

MacBook Air M5でローカルLLMの速度ベンチマークを実施。LM Studioを使い、Gemma3-4B、Qwen3.5-9B、gpt-oss-20bを実際に動かしてtok/secを比較。M2やM4 Max、Ryzen AIノートとも性能差を検証しました。

はじめに

Macbook Air(M2, 16GB, 256GB)のSSD容量が厳しくなってきたので、Macbook Air(M5, 24GB, 1TB)に買い換えました。そこで、LLMの実行速度をチェックしてみました。

M5はGPUの強化により、LLMの実行がかなり高速になっていると言われていますが、実際に使えるレベルかどうかを評価してみます。

評価

今回購入したMacはメモリが24GBなので、16GB以下程度のモデルしかロードできない感じです。ということで、試してみて動いた gpt-oss-20b と Qwen3.5-9B、Gemma3-4B モデルを使って比較を行いました。

| モデル名 | 量子化 | サイズ |

| Gemma3-4B | 4bit | 3.0GB |

| Qwen3.5-9B | 4bit | 6.5GB |

| gpt-oss-20b | 4bit | 12.1GB |

Macbook Air(M2)ではメモリ的に厳しいので、Qwen3.5-9B と gpt-oss-20b は3機種のみで比較しました。

比較した機種

| 機種名 | スペック(CPU, メモリ) |

| Macbook Air (M5) | M5, 24GB (10CPU, 10GPU) |

| Macbook Air (M2) | M2, 16GB(8CPU, 8GPU) |

| Macbook Pro (M4Max) | 149.93tok/sec(16CPU, 40GPU) |

| Omnibook 7 Aero | AMD Ryzen™ AI 7 350 、32GB |

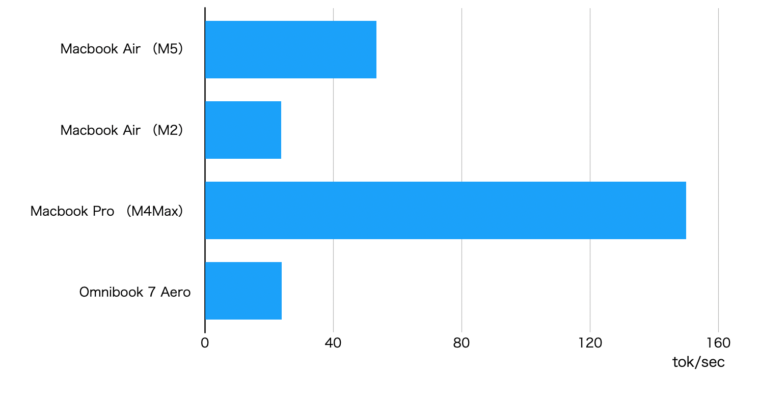

Gemma3-4B

M2と比較して 2倍以上高速 になっています。これは結構驚きです。M4 Maxと比較すると、さすがに遅いですが。

| 速度 | |

| Macbook Air (M5) | 53.44 tok/sec |

| Macbook Air (M2) | 23.69 tok/sec |

| Macbook Pro (M4Max) | 149.93 tok/sec |

| Omnibook 7 Aero | 23.94 tok/sec |

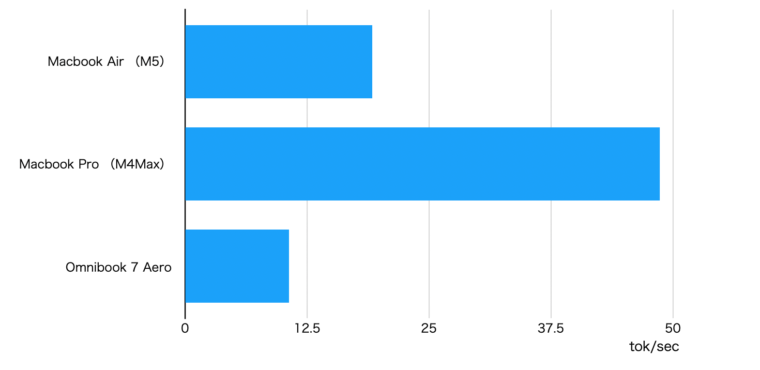

Qwen3.5-9B

Qwen3.5-9Bでは、コンテキストサイズを最大に設定することができませんでした(M5、Omnibook)。

メモリが 24GB、32GBではコンテキストサイズを最大にすると不足する ようです。

| 速度 | |

| Macbook Air (M5) | 19.16 tok/sec |

| Macbook Pro (M4Max) | 48.67 tok/sec |

| Omnibook 7 Aero | 10.67 tok/sec |

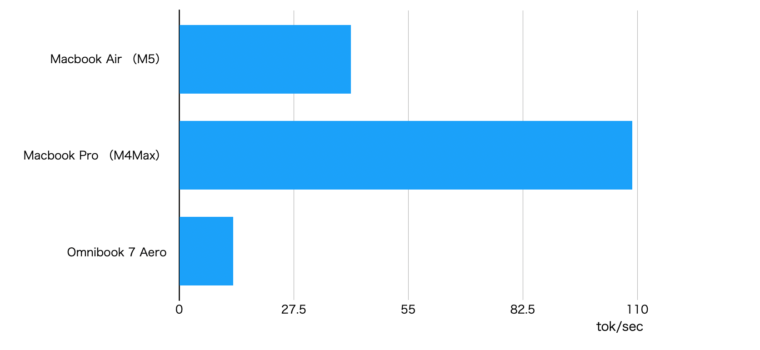

gpt-oss-20b

gpt-oss-20bは、モデルサイズは Qwen3.5-9Bより大きい ですが、MoEのため一度にアクティブになるサイズが小さく、高速 です。

| 速度 | |

| Macbook Air (M5) | 41.24 tok/sec |

| Macbook Pro (M4Max) | 108.84 tok/sec |

| Omnibook 7 Aero | 12.91 tok/sec |

賢さと速度のバランスを考えると、このモデルが使いやすそうです。

Omnibook 7 Aero 13-bgも、32GBメモリを搭載するとMacBook Air M5と似たような価格に値上がりしているので、gpt-oss-20bクラスのLLMを使うことを考えるとMacの方がいい気がします。

まとめ

Macbook Air M5のLLMベンチマークを行ってみました。

24GBしかメモリを積んでいないため動作するLLMは限られていますが、Qwen3.5-9B、gpt-oss-20bあたりが動けば普段使いには十分です。

速度と性能を考えると、gpt-oss-20bが一番使い勝手が良いかなと感じました。

実はgpt-oss-20bを普段のプログラミングなどでも使っていますが、ChatGPT5.4やGemini 3 Proなどには劣るものの、ちょっとしたコードならちゃんと出力してくれるレベルです。

このレベルのモデルが、Macbook Airでも普通に使える速度(40 tok/sec)で動作するようになったのは驚きです。

あと、Macbook Airと同価格帯のOmnibook 7 Aeroは、AI PCということで期待していましたが、LLMの速度については予想より振るわない結果となりました。LLM実行についてはMac優位な感じですね。